Feedback Graph Convolutional Network for Skeleton-based Action Recognition

作者 | Hao Yang, Dan Yan

单位 | NUCTECH Company Limited

论文地址 |https://arxiv.org/abs/2003.07564

摘要

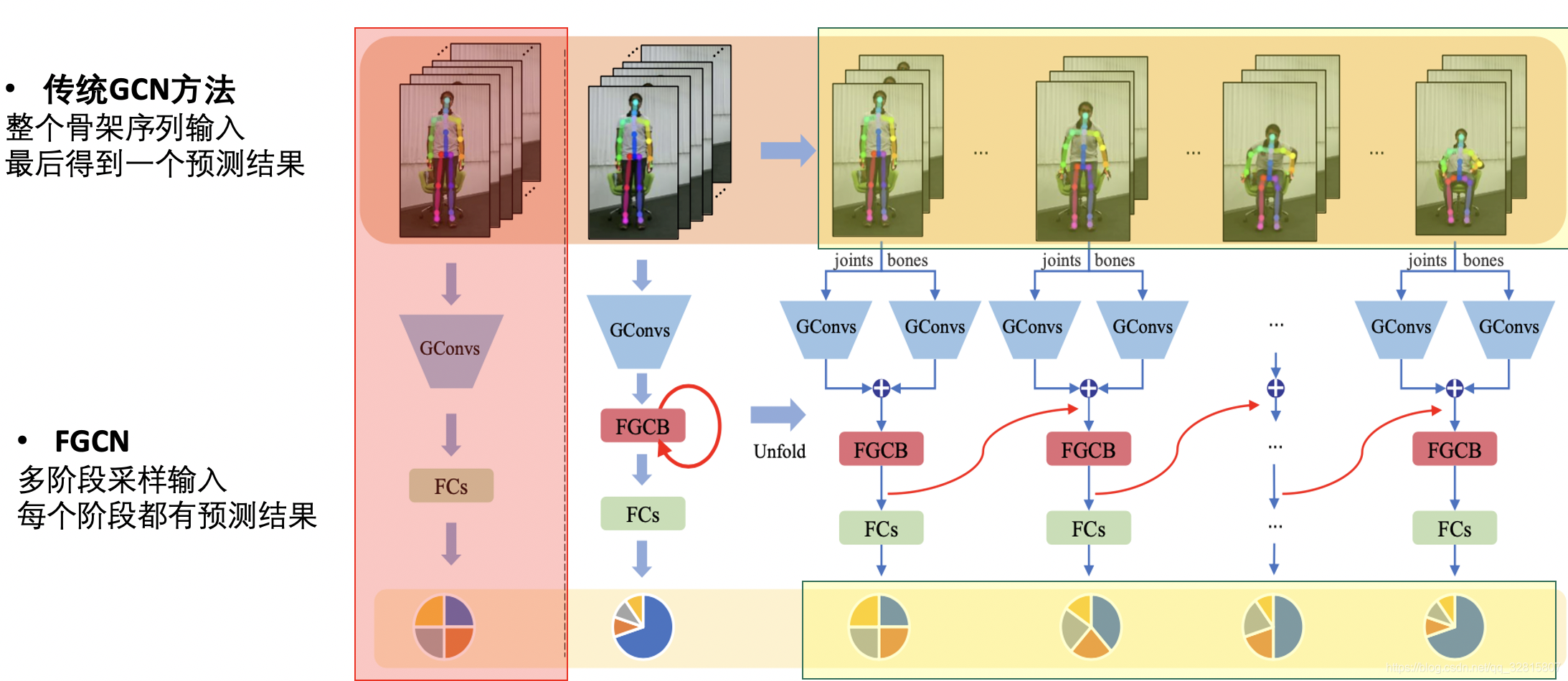

近年来,许多学者利用图卷积网络(GCN)对骨架序列进行端到端优化建模。然而,传统的gcn是前馈网络,浅层不能访问到深层的语义信息,在这篇论文中,提出一个新的网络,称为反馈图卷积网络(FGCN)

这是首次将反馈机制引入GCNs和动作识别中

与传统的gcn相比,FGCN具有以下优点

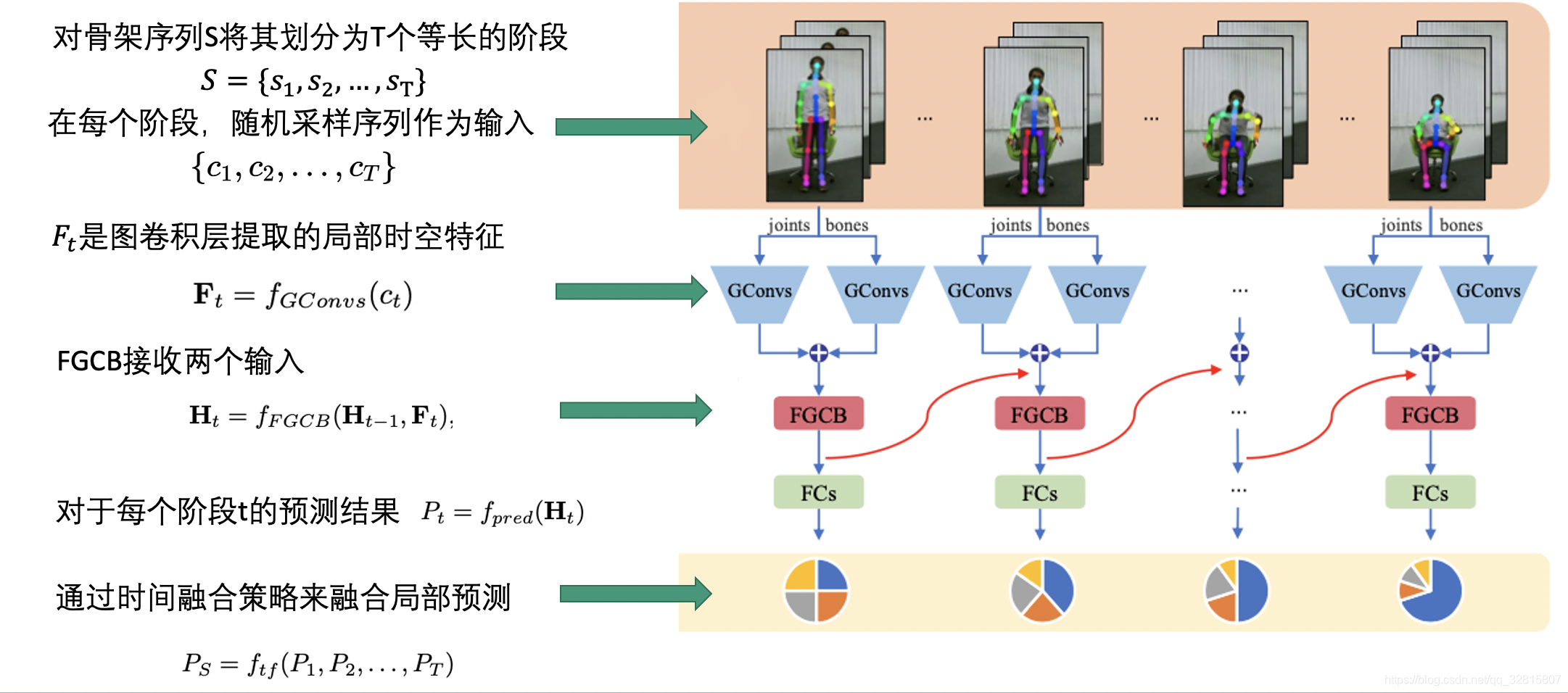

设计了一种多阶段的时间采样策略,以从粗到精的渐进过程提取动作识别的时空特征

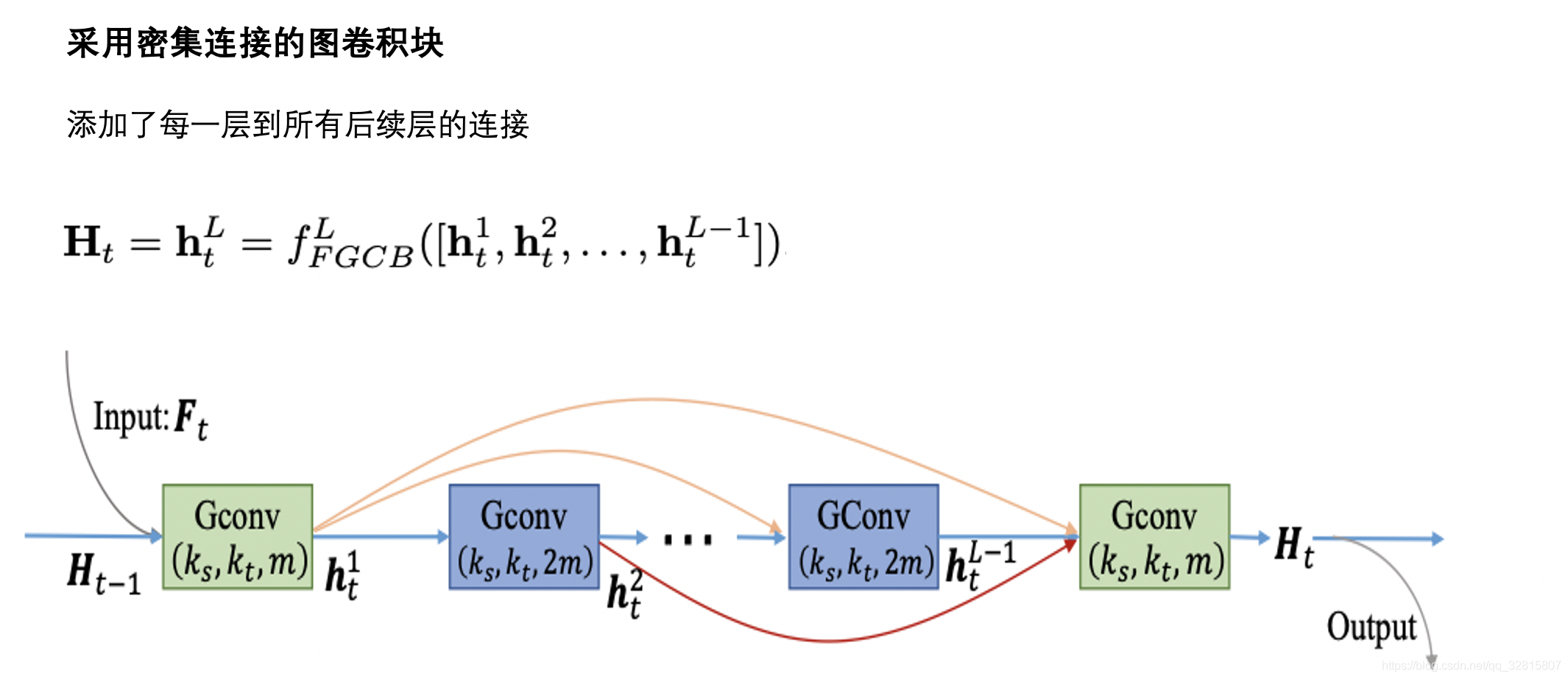

提出了一种基于稠密连接的反馈图卷积块(FGCB)来引入反馈连接,它将高层语义特征传递到底层,并逐级传递时间信息,逐步建立全局时空特征模型,用于动作识别

FGCN模型提供了早期预测。在早期阶段,模型接收到关于动作的部分信息。当然,它的预测相对粗糙。将粗预测视为先验知识,指导后期特征学习,实现精确预测

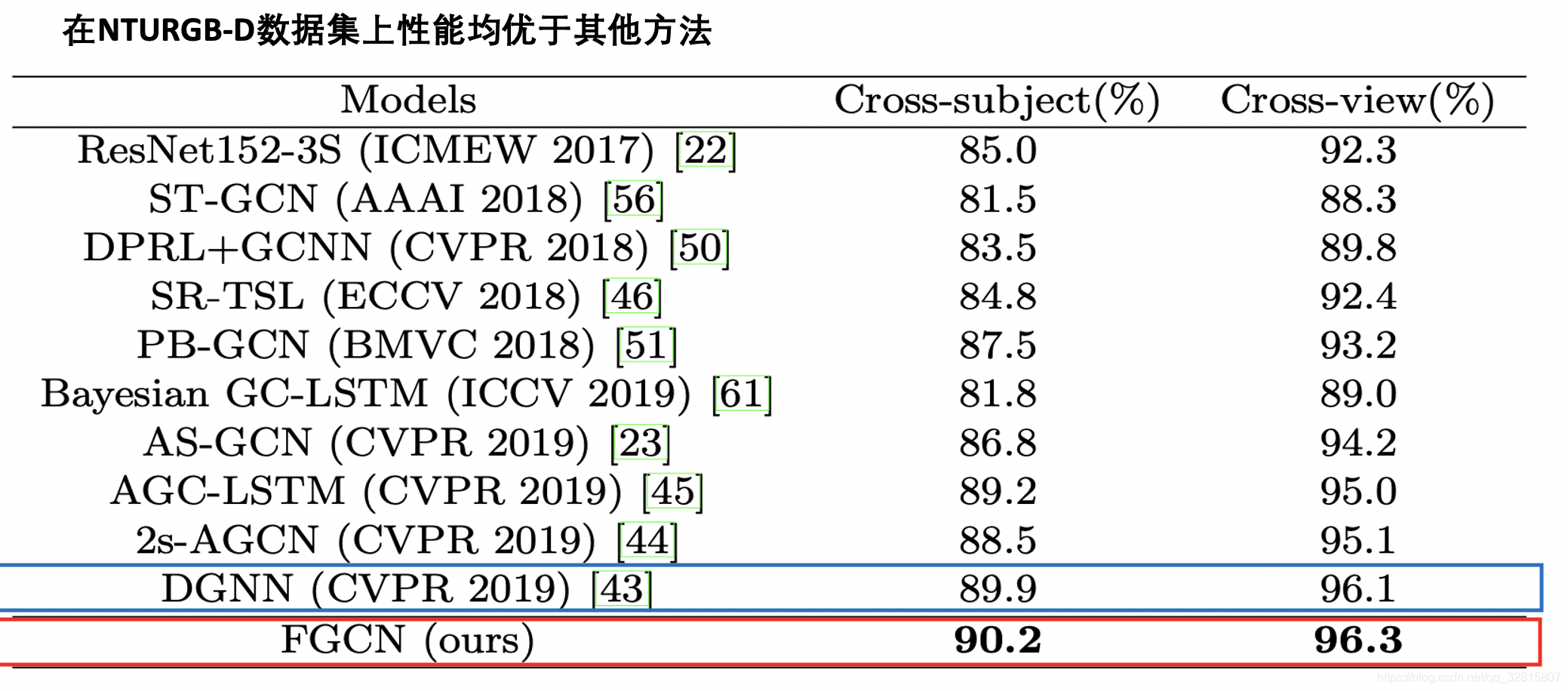

在NTU-RGB+D、NTU-RGB+D120和Northwestern-UCLA的数据集上进行了大量的实验,结果表明所提出的FGCN对动作识别是有效的。它在三个数据集上达到了最先进的性能

引言

近年来,从不同终端上传的视频数量已经增加。这推动了对基于视频内容的人类行为分析的迫切需求。尤其是与RGB和光流等其他模式相比,骨架人体行为识别因其对动态环境和复杂背景的影响具有较强的适应性而吸引了许多计算机视觉研究者。早期使用骨骼进行动作识别的深度学习方法通常将骨骼数据表示为关节坐标向量序列或伪图像,然后分别由RNN或CNN建模

然而,这些方法并没有显式地利用相关关节之间的空间依赖性,即使空间依赖性对于理解人类行为是有用的。最近,一些方法根据连续帧的自然连接和时间边缘来构造时空图。然后他们利用GCN来模拟时空特征。然而,传统的gcn都是单个前馈网络,由整个骨架序列当作输入。这些方法很难提取出有效的时空特征,因为这些有用的信息通常被隐藏在与运动无关或未区分的片段中。例如,在“踢某物”动作中,大多数片段是“直立站立”,而在“穿鞋”动作中,大多数片段都是坐在椅子上。因此,对于低层,单通前馈网络无法访问深层语义信息。同时,输入整个骨架序列增加了模型的计算复杂度。

基于这一点,提出了一种新的神经网络,称为反馈图卷积网络(FGCN),以粗到精的渐进过程从骨架数据中提取有效的时空特征,用于动作识别。FGCN是第一个将反馈机制引入GCNs和动作识别的工作。与传统的gcn相比,FGCN具有多阶段的时间采样策略,该策略将输入的骨架序列在时域内分为多个阶段,并从时域对输入的骨架片段进行稀疏采样,避免了整个骨架序列的输入。对每一级输入的空时图像进行局部卷积提取。提出了一种基于反馈图卷积块(FGCB)融合局部特征的全局时空特征建模方法。FGCB是一个局部稠密图卷积网络,每个级到下一级都有横向连接,它将反馈连接引入到传统的gcn中。从语义角度看,它是自上而下的工作方式,这使得低层卷积层能够在每个阶段访问高层的语义信息。在时域上,FGCB的反馈机制具有一系列因果关系,前一级的输出流入下一级,以调节其输入。

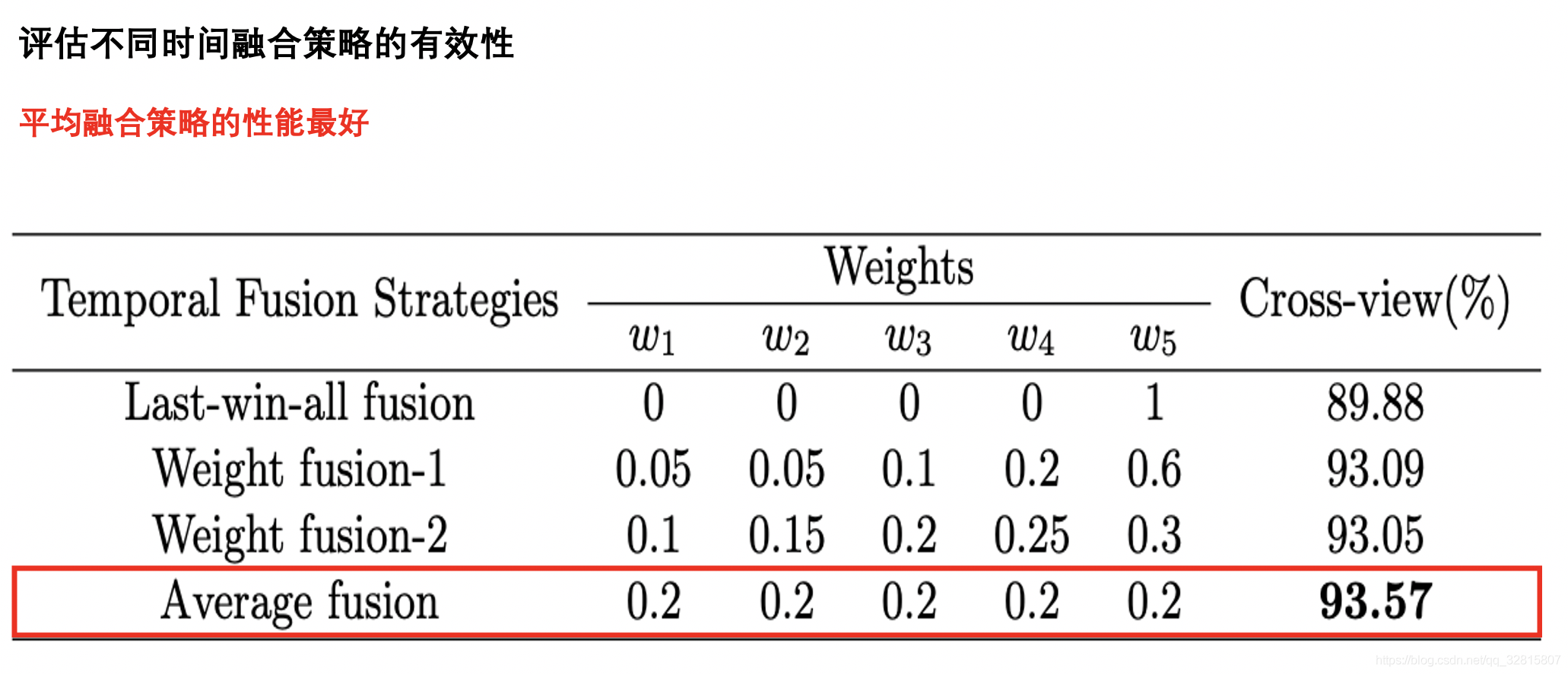

FGCN的另一个优点是它可以在总推理时间的一小部分时间内提供输出的早期预测。这在许多应用中都很有价值,例如机器人或自动驾驶,在这些应用中,延迟时间是非常关键的。早期预测是所提出的多阶段从粗到细逐步优化的结果。在早期阶段,FGCN只提供了一部分骨架序列,而且有关该行为的信息有限,因此其推断相对粗糙。这些推理被视为在以后阶段指导特征学习的先验知识。在后期阶段,该模型接收到更完整的行为信息和先前推理的引导者信息,从而输出更精确的推理。提出了几种时域融合策略,将局部预测融合到视频级预测中。这些策略使网络在渐进过程中得到优化。

方法

反馈图卷积网络

传统的基于GCNs的动作识别方法都是在一个前馈网络中输入整个骨架序列。然而,当输入整个骨架序列时,有用的信息通常隐藏在与运动无关且无差别的片段中。单通前馈网络不能在浅层访问语义信息。为了解决这些问题,提出了一种反馈图卷积网络(FGCN),该网络通过多级递进过程提取时空特征。具体地说,FGCN设计了一种多阶段的时间采样策略来从骨架数据中稀疏地采样一系列输入片段,而不是直接对整个骨架序列进行操作。这些片段首先被输入到图的卷积层中以提取局部时空特征。然后,提出了一种反馈图卷积块(FGCB),通过将前一级的高级信息传输到下一级来调制其输入,从而融合来自多个时间阶段的局部时空特征。最后,提出了几种时间融合策略,将所有时间阶段的局部预测进行融合,给出一个视频级的预测。

反馈图卷积块(FGCB)

反馈模块FGCB是FGCN模型的核心部分。一方面,FGCB将高层语义信息传回低层,以细化其编码特征。另一方面,前一级的输出流入下一级,以调节其输入。为了使FGCB能够有效地将信息从高层传输到低层,以及从前一个阶段传输到下一个阶段,提出了一个密集连接的局部图卷积网络,它增加了从每一层到所有后续层的连接

实验

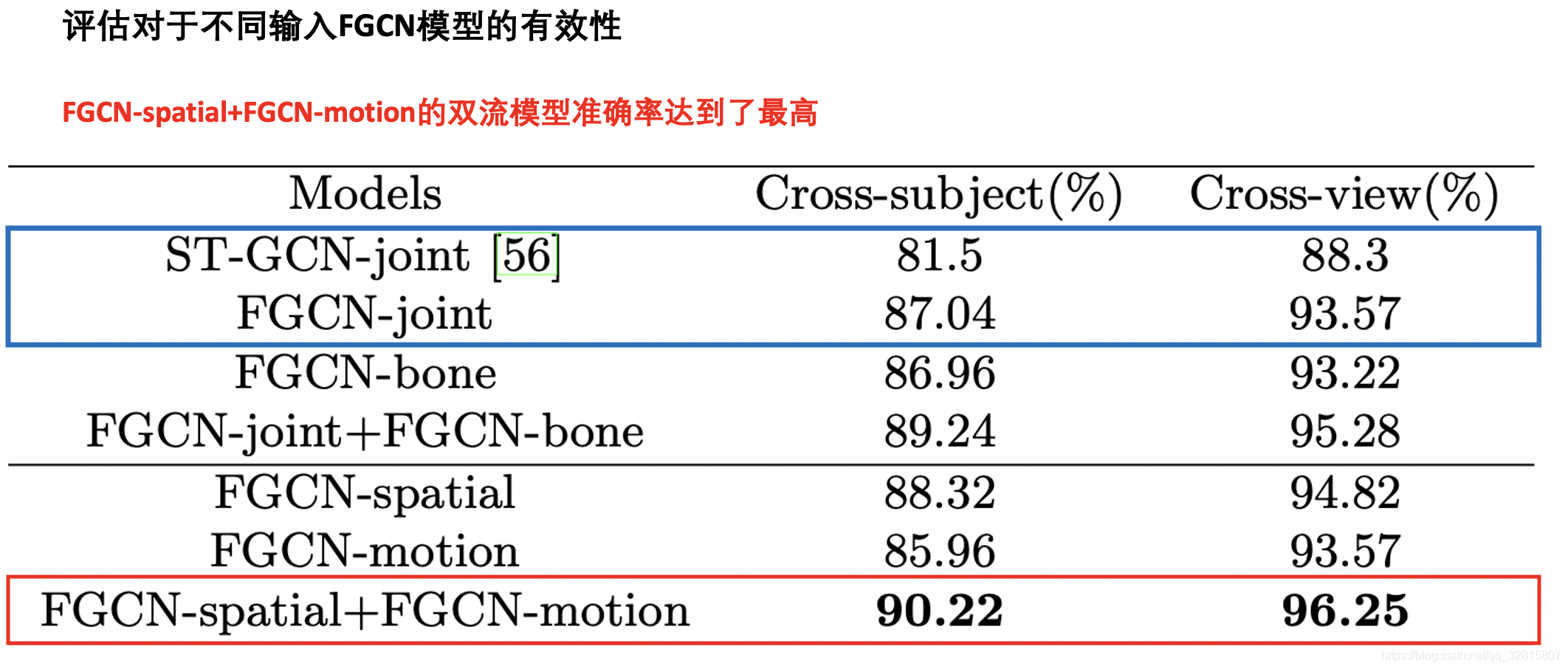

设计了四个消融实验来评估不同超参数、结构和输入对FGCN模型性能的影响。这些消融实验都是在NTU-RGB+D上进行的

实验细节

所有实验均采用PyTorch深度学习框架实现。训练过程中采用随机梯度下降(SGD)优化器,batch-size为32,momentum为0.9,初始学习率为0.1。在第40和60 个epoch,学习率除以10。训练过程在第80 epoch结束

输入的视频在时间上分为五个阶段,每个阶段随机抽取64个连续的帧组成一个输入片段。十个图卷积层堆叠在反馈块FGCB的前面,这些层具有与ST-GCN中的图卷积层相同的配置。FGCB有四个图形卷积层(即L=4),将它们的时空核大小和输出通道分别设置为ks=3、kt=3和m=256